遠隔でのモニタリングなどにおいて、相手の気持ちから現れるわずかな表情の変化を検知

2019-10-15 株式会社富士通研究所,Fujitsu Laboratories of America Inc

株式会社富士通研究所(注1)(以下、富士通研究所)とFujitsu Laboratories of America Inc.(注2)(以下、米国富士通研究所)は、このたび、Carnegie Mellon University School of Computer Science(注3)(以下、カーネギーメロン大学コンピューターサイエンス学部)と共同で、こまやかな表情の変化を高精度に検出可能なAI表情認識技術を開発しました。

これまでも、表情筋の動きから表情変化を捉える手法は使われてきましたが、様々な動作の中の顔から検出モデルを学習するには膨大なデータが必要になるため、精度に問題がありました。今回、例えば斜めを向いている顔に対しても、顔を正面から撮影した基準となる画像に近づくように補正を行う技術により、小規模なデータで検出モデルを学習することができます。これにより、普段の動作で生じる様々な顔の向きや角度においても、苦笑いや喜びの驚き、戸惑いを感じた際などのこまやかな表情変化を高精度に検出できます。

本技術により、わずかな相手の反応を顔の表情の変化から検知することが可能になり、遠隔業務でのコミュニケーションや、ドライバーや工場作業者のモニタリングなどへの適用が期待できます。

開発の背景

近年、顔映像から表情変化を捉え、人の感情を推定する技術が注目されています。これまでは、喜怒哀楽など、口角や目じりが大きく動く明確な表情変化を対象とした技術が開発され、撮影動画のハイライトシーンの自動抽出や人の感情に応じて動作を変える応対ロボットなどの用途で実用化されています。今後は、医療分野における患者の様子の観察や、マーケティングにおける顧客の商品に対する反応の分析など、様々な場面での高度な活用が期待されています。

課題

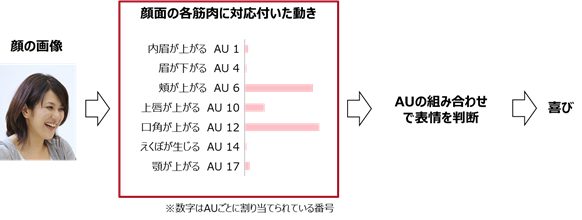

人の感情を高度に推定するには、納得や戸惑い、ストレスなど、こまやかな表情変化を捉えることが重要となります。近年、このようなこまやかな表情変化を扱うために、解剖学的知見に基づき、顔面の各筋肉に対応づいた動きの単位として定義されたAction unit(以下、AU)の活用が進み、心理学研究やアニメーションの生成など様々な分野で利用されています。AUは、眉が下がる・頬が上がる、といった顔面の各筋肉の動きに基づいて約30種に分類され、これらのAUを組み合わせることで、喜怒哀楽に加えて、こまやかな表情変化も捉えることができます。一般的にAUの検出にはディープラーニングが使われるため、ディープラーニングのための大規模な学習データの準備が必要となります。特に、実際の環境では、様々な角度・大きさ・位置の顔がカメラで撮影されるため、それぞれに対応した大規模な学習データを準備することが難しく、結果として十分な検出精度を実現するのが困難でした。

図1. AUと表情の関係原理図

開発した技術

今回、富士通研究所と米国富士通研究所は、カーネギーメロン大学コンピューターサイエンス学部との共同研究で、AUごとに最適化された画像変換を用いて、小規模な学習データでも高精度にAUを検出するAI表情認識技術を開発しました。

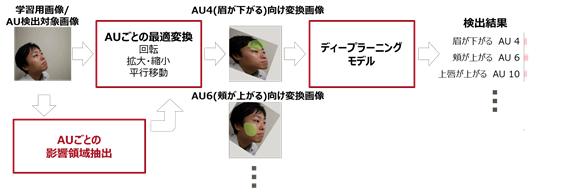

- 顔を正面から撮影した基準となる画像に近づける入力画像変換処理により、少ない学習データでAUを検出本技術では、様々な角度・大きさ・位置で撮影された顔の画像に対して、顔を正面から撮影した基準の画像に見え方が近づくように、回転や拡大・縮小、平行移動などの変換処理を行います。これにより、大規模にそれぞれの顔の角度などに対応した学習データを準備することなく、小規模な学習データでもAUを検出することができます。

- AU検出に影響する領域をAUごとに分析することで高い検出精度を実現変換処理では、画像における顔の複数の特徴点が、基準となる正面の顔の画像における特徴点の位置に近づくように変換を行いますが、特徴点を顔の部位のどこに設定するかによって、回転や拡大・縮小、平行移動の量が変わってきます。例えば、特徴点を目の周辺と設定して回転処理を実行すると、目の周辺は基準の顔の画像に近い位置となりますが、口などの部位は基準の顔の画像とずれた位置になります。

そのため、撮影された顔の画像から、AU検出に影響の大きな領域を分析し、その領域周辺の特徴点が、基準の顔の画像の特徴点の位置に近づくように、回転や拡大・縮小、平行移動の量を調整します。基準の顔の画像の見え方に近づける変換処理を、AUごとに調整することで、高精度にAUを検出します。

図2. 開発した技術

効果

本技術により、表情データセットFERA2017(Facial Expression Recognition and Analysis Challenge 2017)に対して、81%と高い検出精度を実現しました。また、FERA2017のベンチマーク指標による比較でも、開発技術が最先端の既存研究よりも高い精度であることを確認しました。

今後

富士通研究所と米国富士通研究所は、遠隔会議支援や社員のエンゲージメント測定、ドライバーの運転の様子の見守りなど、様々な利用シーンでの実用化を目指します。

商標について

記載されている製品名などの固有名詞は、各社の商標または登録商標です。

以上

注釈

- 注1 株式会社富士通研究所:

- 本社 神奈川県川崎市、代表取締役社長 原 裕貴。

- 注2 Fujitsu Laboratories of America Inc.:

- 本社 米国カリフォルニア州、COO 小柳 洋一。

- 注3 Carnegie Mellon University School of Computer Science:

- 所在地 米国ペンシルベニア州、学部長 Martial Hebert。

本件に関するお問い合わせ

株式会社富士通研究所

人工知能研究所

プレスリリースに記載された製品の価格、仕様、サービス内容、お問い合わせ先などは、発表日現在のものです。その後予告なしに変更されることがあります。あらかじめご了承ください。