1504数理・情報

1504数理・情報 AIは人間と区別困難な金融研究論文を大量生成可能(AI Can Mass-Produce Finance Research Papers Indistinguishable From Human Work)

2026-025-28 ペンシルベニア州立大学(Penn State)米ペンシルベニア州立大学(Penn State)の研究チームは、生成AIが金融分野の学術論文を大量に作成でき、その一部は専門家であっても人間が執筆した論文と区別することが...

1504数理・情報

1504数理・情報  1603情報システム・データ工学

1603情報システム・データ工学  1603情報システム・データ工学

1603情報システム・データ工学  1603情報システム・データ工学

1603情報システム・データ工学  1603情報システム・データ工学

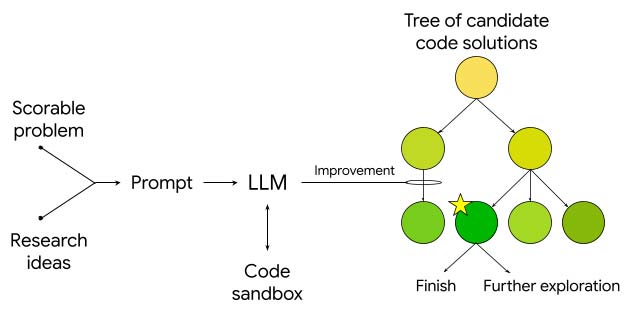

1603情報システム・データ工学  1602ソフトウェア工学

1602ソフトウェア工学  1603情報システム・データ工学

1603情報システム・データ工学  1603情報システム・データ工学

1603情報システム・データ工学  1603情報システム・データ工学

1603情報システム・データ工学  1603情報システム・データ工学

1603情報システム・データ工学  1502サービスマネジメント

1502サービスマネジメント  1603情報システム・データ工学

1603情報システム・データ工学