マスキングしている場合は、耳認証の方が便利かもしれません Ear recognition may be more convenient if you’re masking

2022-12-08 ジョージア大学 (UGA)

耳は、指紋と同じように個人に固有のものである。一卵性双生児の耳にも違いがある、と研究者は述べている。さらに、耳は顔と同じように年をとらない。ただし、耳たぶは年をとるにつれて下がってくる。

この耳認識ソフトは、顔認識と同じような仕組みになっている。新しい携帯電話を購入する際、指紋や顔を登録することで、携帯電話に認識させることができる。新しいデバイスでは、指紋の完全な「画像」を取得するために、ユーザーがセンサーに何度も指を置く必要があることが多い。また、顔認証の場合は、カメラの前で顔を一定方向に動かして、顔の特徴を効果的にとらえる必要がある。研究者が提案する耳の認識アルゴリズムも同じように動作する。

研究者は、耳画像の2つの異なる既存のデータセットを使用して、アルゴリズムをテストした。一方のデータセットでは、先行する耳認識ソフトウェアと比較して、システム性能が58.72%から97.25%の精度に向上し、もう一方では、ベースライン手法と比較して、性能が45.8%から75.11%に向上している。

研究チームは、混雑した画像でもシステムが機能することを確認するため、ぼやけ具合、明るさ、コントラストなどの画像ノイズ要因の影響を受けた耳画像を用いて、いくつかのモデルを評価しました。

<関連情報>

- https://news.uga.edu/new-facial-recognition-technology-scans-your-ear/

- https://ieeexplore.ieee.org/document/9887947

効率的な耳認識のための画質評価 Image Quality Assessment for Effective Ear Recognition

Susan El-Naggar; Thirimachos Bourlai

IEEE Access Published:12 September 2022

DOI: 10.1109/ACCESS.2022.3206024

Abstract

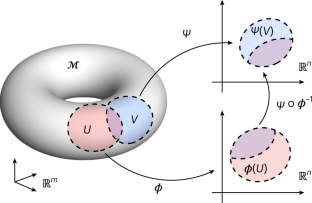

Due to the recent challenges in access control, surveillance and security, there is an increased need for efficient human authentication solutions. Ear recognition is an appealing choice where the data acquisition procedure is contactless, non-intrusive, and covert. This article proposes a deep learning-based solution for effective ear recognition. First, we explore multiple strategies to enhance learning using alternative ear datasets with a wide range of ear poses. Second, we investigate the performance of the proposed deep ear models in the presence of various image artifacts, which commonly occur in real-life recognition applications, to identify the robustness of the proposed ear recognition models in controlled and uncontrolled conditions (dataset dependent). Finally, we propose an efficient ear image quality assessment tool designed to guide the proposed ear recognition system. By performing a set of experiments on extended degraded ear datasets, we determine that the employment of the proposed ear image quality assessment tool improves ear identification performance from 58.72% to 97.25% for the USTB degraded dataset and from 45.80% to 75.11% for the degraded FERET dataset.