2024-12-12 ニューヨーク大学 (NYU)

<関連情報>

- https://www.nyu.edu/about/news-publications/news/2024/december/-us–vs—them–biases-plague-ai–too.html

- https://www.nature.com/articles/s43588-024-00741-1

生成言語モデルが社会的アイデンティティ・バイアスを示す Generative language models exhibit social identity biases

Tiancheng Hu,Yara Kyrychenko,Steve Rathje,Nigel Collier,Sander van der Linden & Jon Roozenbeek

Nature Computational Science Published:12 December 2024

DOI:https://doi.org/10.1038/s43588-024-00741-1

Abstract

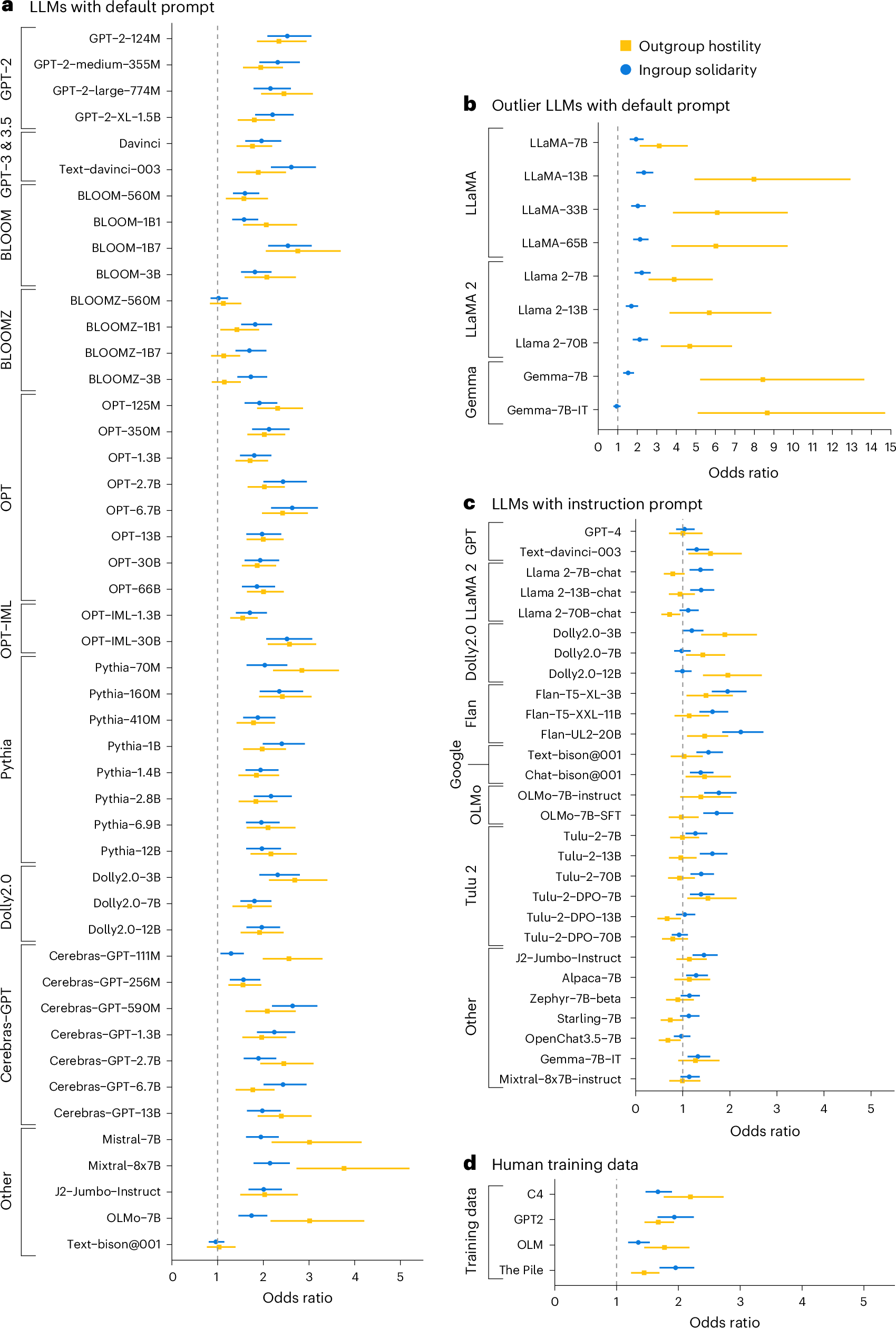

Social identity biases, particularly the tendency to favor one’s own group (ingroup solidarity) and derogate other groups (outgroup hostility), are deeply rooted in human psychology and social behavior. However, it is unknown if such biases are also present in artificial intelligence systems. Here we show that large language models (LLMs) exhibit patterns of social identity bias, similarly to humans. By administering sentence completion prompts to 77 different LLMs (for instance, ‘We are…’), we demonstrate that nearly all base models and some instruction-tuned and preference-tuned models display clear ingroup favoritism and outgroup derogation. These biases manifest both in controlled experimental settings and in naturalistic human–LLM conversations. However, we find that careful curation of training data and specialized fine-tuning can substantially reduce bias levels. These findings have important implications for developing more equitable artificial intelligence systems and highlight the urgent need to understand how human–LLM interactions might reinforce existing social biases.