2023-06-13 カリフォルニア大学サンディエゴ校(UCSD)

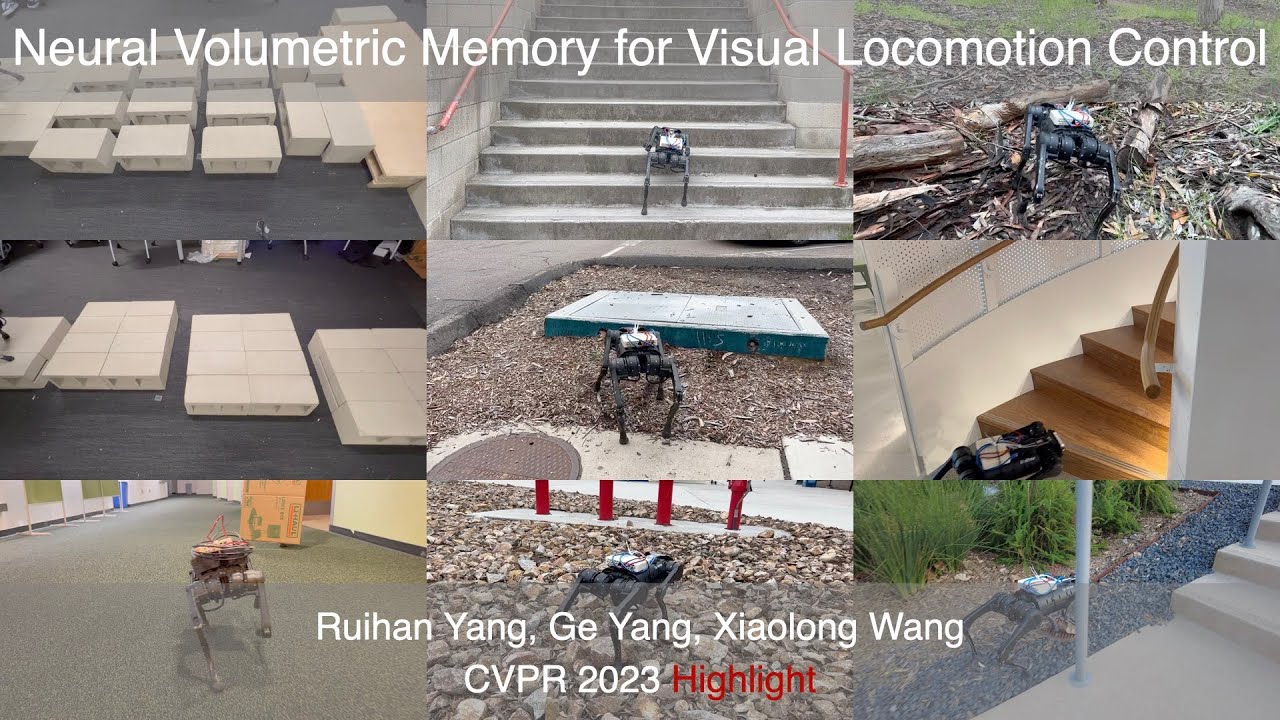

◆研究はCVPR学会で発表され、現実世界の複雑な環境での展開が可能になります。ロボットは前方に深度カメラを備え、2D画像を3D空間に変換するモデルを使用して周囲の情報を理解し、移動を制御します。これにより、ロボットはより困難な地形を横断できるようになりました。

<関連情報>

- https://today.ucsd.edu/story/four-legged-robot-traverses-tricky-terrains-thanks-to-improved-3d-vision

- https://arxiv.org/abs/2304.01201

視覚的ロコモーション制御のための神経体積記憶

Neural Volumetric Memory for Visual Locomotion Control

Ruihan Yang, Ge Yang, Xiaolong Wang

arXiv Submitted on :3 Apr 2023

DOI:https://doi.org/10.48550/arXiv.2304.01201

Legged robots have the potential to expand the reach of autonomy beyond paved roads. In this work, we consider the difficult problem of locomotion on challenging terrains using a single forward-facing depth camera. Due to the partial observability of the problem, the robot has to rely on past observations to infer the terrain currently beneath it. To solve this problem, we follow the paradigm in computer vision that explicitly models the 3D geometry of the scene and propose Neural Volumetric Memory (NVM), a geometric memory architecture that explicitly accounts for the SE(3) equivariance of the 3D world. NVM aggregates feature volumes from multiple camera views by first bringing them back to the ego-centric frame of the robot. We test the learned visual-locomotion policy on a physical robot and show that our approach, which explicitly introduces geometric priors during training, offers superior performance than more naïve methods. We also include ablation studies and show that the representations stored in the neural volumetric memory capture sufficient geometric information to reconstruct the scene. Our project page with videos is this https URL .