2023-09-26 富士通株式会社

当社はこのたび、対話型生成AIから出力される回答の信頼性を向上する2つのAIトラスト技術である幻覚検出技術とフィッシングURL検出技術を開発しました。これらの技術を、「Fujitsu Kozuchi (code name) – Fujitsu AI Platform」の対話型生成AIコアエンジンに搭載し、2023年9月28日より順次、日本国内に法人向けの実証実験環境として提供を開始し、個人向けにも当社ポータルサイト上からトライアル環境を提供します。今後は、グローバルにも展開予定です。

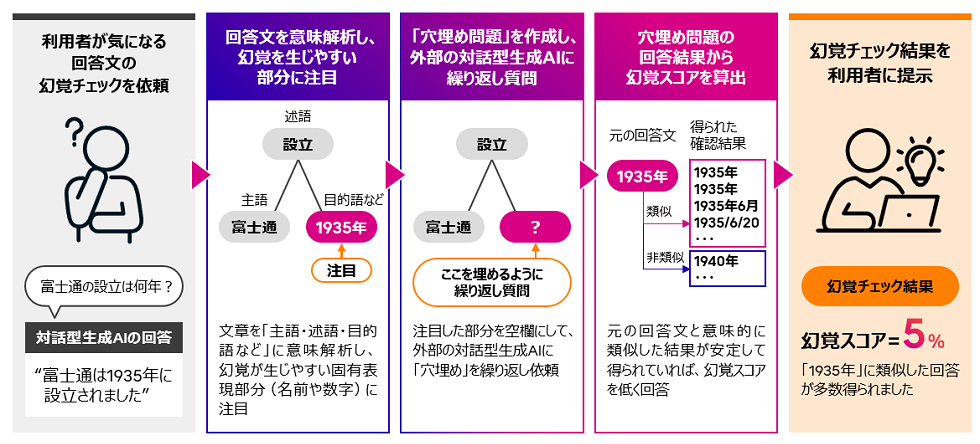

1つ目のAIトラスト技術は、対話型生成AIがデータに基づかないもっともらしい誤りを回答してしまう幻覚(ハルシネーション)を検出する技術で、対話型生成AIの回答文をAIが意味解析し、且つ幻覚が生じやすい固有表現部分を特定して重点的に確認することで、既存手法よりも幻覚を高精度に検出します。

2つ目は、対話型生成AIが、悪意ある情報を覚え込ませる攻撃を受けてフィッシングサイトURLを回答出力してしまう問題に対応できる技術で、対話型生成AIに本技術を搭載することで、AIを騙す既存の敵対的攻撃を含むフィッシングサイトを高度に検出し、利用者に危険なURLであることを伝えます。

当社は今後も、対話型生成AIをはじめとするAIの品質やセキュリティ、倫理などのAIトラストを向上させる技術を世界に先駆けて研究開発し、実証実験や有効性検証を進めることで、お客様が安心してAIを利用できる社会づくりに貢献していきます。

背景と課題

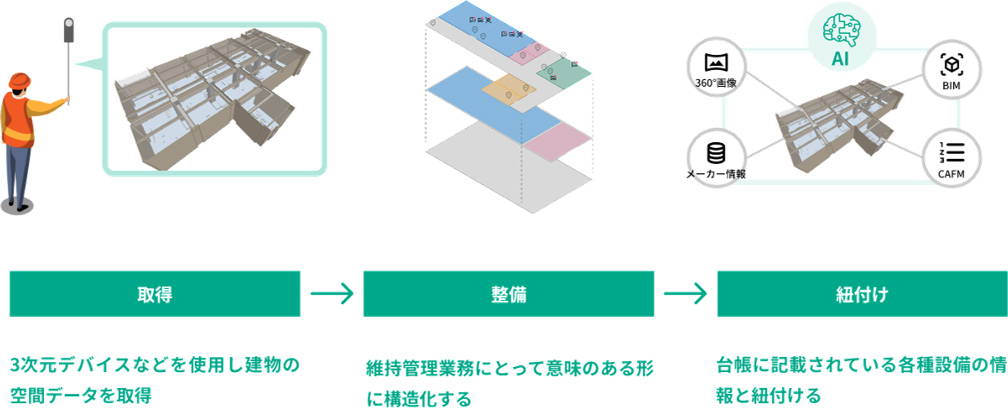

現在、ChatGPT(注1)のように、大量のテキスト情報を学習し幅広いトピックで自然なやりとりができる対話型生成AIが注目を集め、多くの企業が業務適用に向けて検討を進める中、高い対話品質やセキュリティ面での信頼性の確保が課題になっています。当社は、長年培ってきたAIの信頼性を担保する研究の取り組みを対話型生成AIに活かし、特に業務への適用が可能な信頼できる対話型生成AIを実現するAIトラスト技術の研究開発を行ってきました(図1)。

今回、この信頼できる対話型生成AIを実現する技術の第一弾として、2つのAIトラスト技術を開発し、「Fujitsu Kozuchi (code name) – Fujitsu AI Platform」の対話型生成AIコアエンジンに搭載しました。

図1. 信頼できる対話型生成AIの全体イメージ

図1. 信頼できる対話型生成AIの全体イメージ

今回開発・適用した技術と成果

1. 幻覚検出技術:

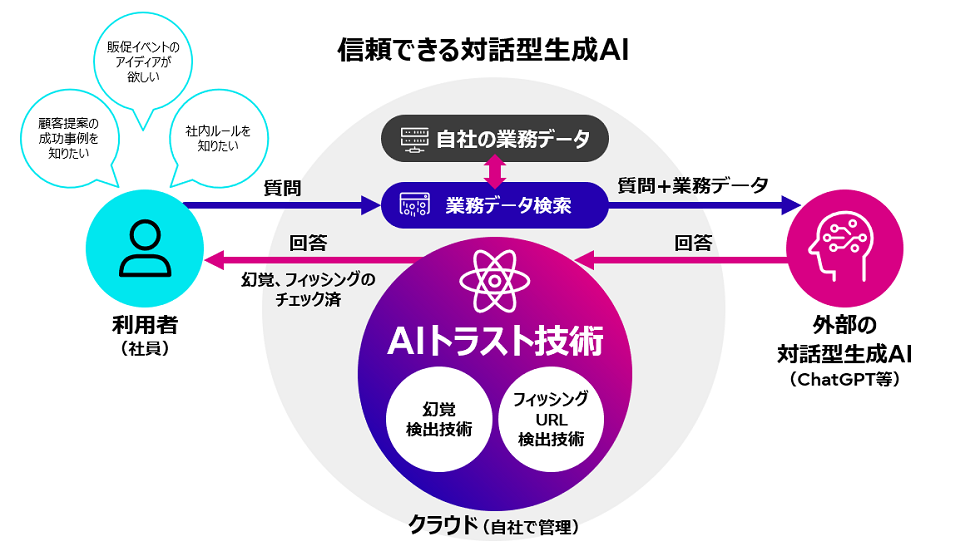

対話型生成AIを業務に適用する際には、事前に登録した業務データから質問に関連する情報を抽出し、外部の対話型生成AIに質問する際に参考情報として付加する方法がよく用いられています。この方法は、業務に関する回答が正確になり、幻覚を抑える効果があるものの、質問に関連した情報を上手く抽出できないケースがあり、その際には幻覚が発生してしまいます。

そのため、回答の幻覚の度合い(幻覚スコア)を推測する取り組みが従来から行われていますが、対話型生成AIは同じ意味でも様々な文章表現で回答するため、幻覚スコアの正確な推測が困難でした。

そこで当社は、対話型生成AIでは幻覚は固有名詞や数値などの固有表現の部分で生じやすく、質問のたびに回答内容が変化しやすい傾向を踏まえ、幻覚が生じやすい箇所を特定して重点的に確認する技術を開発しました。具体的には、回答文を主語、述語、目的語などに分解し、その中の固有表現部分を特定し、且つそこを空欄にし尋ねる穴埋め質問を自動で作成して外部の対話型生成AIへ複数回質問することで、固有表現部分の回答のばらつきをより正確に捉え高精度な幻覚スコアの算出を実現しました(図2)。

当社は本技術について、WikiBio GPT-3 Hallucination Dataset(注2)などのオープンデータを用いてベンチマークを行い、SelfCheckGPT(注3)などの他のAIの幻覚を検出する最新手法に対し検出の正確さの指標(AUC- ROC)(注4)を約22%向上できることを確認しました。

図2. 幻覚検出技術の動作イメージ

図2. 幻覚検出技術の動作イメージ

2. フィッシングURL検出技術:

対話型生成AIは学習した情報に基づいて応答するため、攻撃者によって学習データに悪意のあるデータを混入させられると、利用者に有害な情報を提供してしまう問題があります。特に偽のウェブサイトに誘導するフィッシング攻撃は、様々なサイバー攻撃の初期手口として最も多く使用され、誤って偽のサイトにIDやパスワードなどの情報を入力すると企業全体のクラウド環境が脅威にさらされる可能性があります。

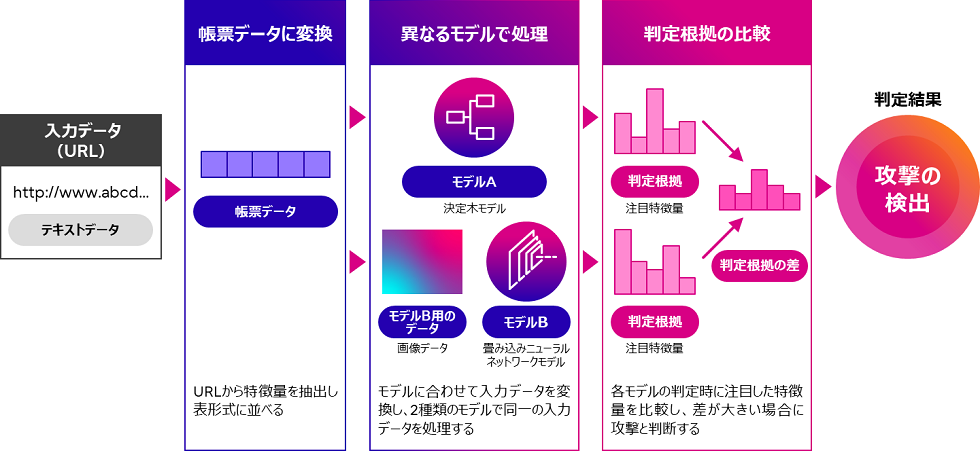

そこで当社は、対話型生成AIの回答文に含まれるURL情報がフィッシングURLかどうかを判定して利用者へ画面上で提示する技術を開発しました。本技術は、フィッシングURLを特定するだけでなく、近年問題視されているAIの判断を故意に誤らせる既存の敵対的攻撃にも対応させることで、信頼性の高い判定を実現しています。この攻撃対策技術には、当社がBen-Gurion University of the Negev(注5)(以下、ベングリオン大学)に設置した「富士通スモールリサーチラボ」(注6)で共同開発した技術を活用しており、AIへの攻撃がそれぞれ個別のAIモデルに向けて特化しやすい傾向を利用し、複数の異なる種類のAIモデルで処理することで生じる判定根拠の違いから攻撃データを見分けています。本技術は、対話型生成AIに限らず、帳票データを扱うAIに対する全般的な攻撃への対策にも活用が期待できます。

図3. フィッシングURL検出技術の概要

図3. フィッシングURL検出技術の概要

今後について

今回開発した技術は、「Fujitsu Kozuchi (code name) – Fujitsu AI Platform」の対話型生成AIコアエンジンに搭載され、幻覚検出技術は2023年9月28日、フィッシングURL検出技術は2023年10月より日本国内で提供開始し、順次グローバルにも展開予定です。また、個人の利用者も、当社の先進技術のAPIやWebアプリケーションを試せる環境であるFujitsu Research Portal(注7)上でアカウントを作成すればトライアル利用が可能になります。

ベングリオン大学 教授 ユーヴァル・エロヴィッチのコメント

生成AIは重要な領域であり、富士通が開発した幻覚検出技術は、信頼できる生成AIシステムを確立するために極めて重要です。また、ベングリオン大学と富士通の研究者らは、敵対的脅威に対するAIベースのURLフィルタリングのセキュリティを強化する革新的な技術を開発しました。私たちのブレークスルーは帳票データに焦点を当てており、AIによるURLフィルタリングの領域において、敵対的攻撃に対してより強靭な防御メカニズムをもたらします。今後も、富士通とベングリオン大学は、生成AIの領域において、セキュリティを中心とした新たな進歩を生み出すために協力していきます。

商標について

記載されている製品名などの固有名詞は、各社の商標または登録商標です。

注釈

注1 ChatGPT:

OpenAI 社が提供する対話型生成AI。https://chat.openai.com/

注2 WikiBio GPT-3 Hallucination Dataset:

幻覚検出で用いられるWikipediaを元にしたベンチマークデータ。https://huggingface.co/datasets/potsawee/wiki_bio_gpt3_hallucination

注3 SelfCheckGPT:

英国ケンブリッジ大学で開発された幻覚検出技術。https://github.com/potsawee/selfcheckgpt

注4 AUC-ROC(Area Under the Curve of the Receiver Operating Characteristic Curve):

真陽性率を縦軸に偽陽性率を横軸にとり、異常度スコアに対して判定の閾値を変化させたときに得られる曲線の曲線下面積。ランダムな異常度スコアの場合に0.5となり、完全に正解した場合には1.0となる。通常、0.7よりも高い場合にある程度の性能が発揮できているとされる。

注5 Ben-Gurion University of the Negev:

本部 イスラエル ベエルシェバ市、総長 ダニエル・チャモヴィッツ。

注6 富士通スモールリサーチラボ:

富士通の研究員が大学内に常駐または長期的に滞在し、共同研究の加速、新規テーマの発掘、人材育成および大学との中長期的な関係構築を目指す取り組み。

注7 Fujitsu Research Portal:

本ポータルサイトは、アカウント登録をすることで当社の先端技術をトライアル利用できるものとして、2023年6月より社外に公開。「Fujitsu Kozuchi (code name) – Fujitsu AI Platform」では法人向けに先進技術を提供しているが、本ポータルサイトを通じて当社の先端技術を、法人に限らず個人の利用者にも公開する。

本件に関するお問い合わせ

富士通コンタクトライン(総合窓口)